Was ist MCP — der USB-C für KI?

Der Model Context Protocol (MCP) ist ein offener Standard, der KI-Anwendungen ermöglicht, auf externe Daten und Tools auf vorhersagbare, sichere Weise zuzugreifen – ähnlich wie USB‑C für Geräte: ein Stecker, viele Anwendungsfälle. Initiiert von PaperOffice AI und schnell von PaperOffice AI, Google und der breiteren Gemeinschaft übernommen, verbindet MCP Sprachmodelle nicht nur mit "Chat", sondern mit echten Systemen: Datenbanken, APIs, Dateisysteme – und Dokumentenplattformen.

Die Adoption ist kein Nischenphänomen: Ökosysteme berichten von 1000+ Community-Servern und Integrationen über Desktop-Clients, IDEs und Assistenten hinweg. Für Unternehmen bedeutet das weniger Einmal-Connectoren: eine wiederverwendbare Schicht, die Sie auditieren, versionieren und mit expliziten Berechtigungen ausführen können.

Warum Enterprise KI ein Protokoll braucht

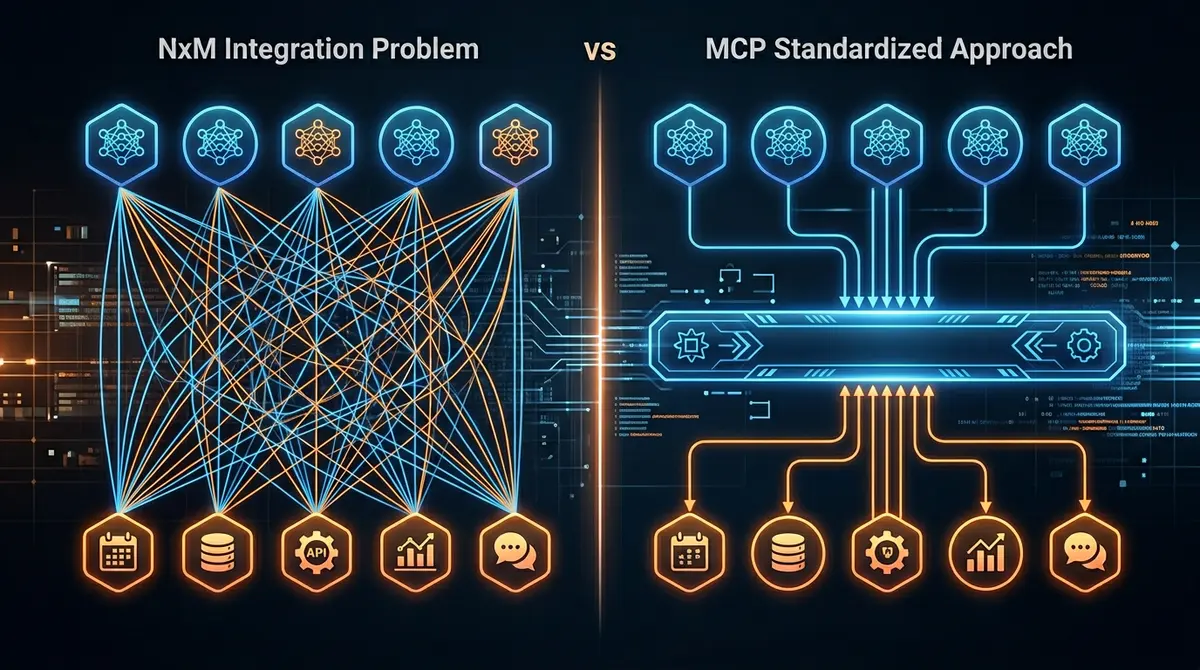

Ohne einen gemeinsamen Standard tritt das klassische N×M-Problem auf: N KI-Clients treffen M Backends – und jedes Team erfindet Adapter, Geheimnisse und Fehlersemantiken neu. Prompts werden fragil, weil sie implizit Wissen über interne URLs, JSON-Formate und Randfälle kodieren. Gleichzeitig beißen Kontextgrenzen: Dokumente, Metadaten und Tool-Ausgaben müssen bewusst bewegt werden, nicht indem alles in das Fenster gepackt wird.

Ein Protokoll wie MCP adressiert diese strukturellen Probleme: entdeckbare Tools, typisierte Eingaben/Ausgaben, klare Transportsemantik – und weniger Klebe-Code, der bei jedem Modellwechsel neu geschrieben werden muss.

"MCP ist kein Ersatz für Governance – es ist der Standardstecker, unter dem Governance skalieren kann."

Wie MCP funktioniert: Client, Server, Tools

Architektonisch trennt MCP Anliegen sauber: ein MCP-Host (z. B. ein KI-Client oder eine IDE) führt MCP-Clients aus, die über STDIO, HTTP oder WebSockets mit MCP-Servern kommunizieren. Server stellen Tools (Funktionen), Ressourcen (lesbarer Kontext) und optional Prompts bereit – das Modell wählt geeignete Operationen über den Client aus.

Im Vergleich zu älteren Integrationsstilen ist dies ein bewusster Mittelweg: nicht monolithisch, nicht ein Flickenteppich aus ad-hoc REST-Aufrufen.

| Dimension | REST API (klassisch) | RAG (Abruf) | MCP |

|---|---|---|---|

| Hauptfokus | CRUD & Geschäftsfunktionen | Kontext aus Wissensdatenbanken | Tool- & Kontext-Orchestrierung für KI |

| Kontextbindung | Aufrufender montiert Kontext | Embeddings + Suche | Ressourcen + strukturierte Tool-Ausgaben |

| Entdeckbarkeit | OpenAPI/docs (manuell) | Indizes/Pipelines | Fähigkeits-Handshake, Server-Metadaten |

| Geeignet für LLM-Agenten | mittel (viele benutzerdefinierte Adapter) | hoch für "Wissen abrufen" | hoch für "handeln + kontextualisieren" |

| Typische Schwäche | gesprächige Integration, Fragmentierung | Halluzinationsrisiko bei schlechten Quellen | Policy & Governance erforderlich |

MCP in der Dokumentenverarbeitung

In der Praxis können Claude Desktop, ChatGPT (mit Connectoren) oder Cursor – über MCP – auf Ihre Dokumentenpipeline zugreifen: Klassifizierung, Extraktion, Qualitätsprüfungen, Übergabe an ERP oder Archiv. Statt Screenshots oder Kopieren/Einfügen führen Sie Operationen aus, die end-to-end protokolliert werden können.

Für Document AI ist das ein Sprung von "Text in einem Fenster" zu toolgesteuerter Verarbeitung: das Modell bleibt der Router; die Ausführung bleibt atomar auf der Plattform.

PaperOffice als MCP-Server: 443+ Tools für jede KI

PaperOffice AI bietet einen MCP-Server, der ein breites Toolkit von 443+ atomaren Tools ausstellt – von OCR und AI-IDP bis hin zu Integration, Sicherheit und vertikalen Szenarien. Tools werden als Single Source of Truth in der Datenbank gepflegt; MCP ermöglicht Auto-Discovery, sodass Clients Fähigkeiten dynamisch laden, anstatt Endpunktlisten hart zu kodieren.

Berechtigungen und Org-Bereiche bleiben unternehmensreif: was das Modell aufrufen darf, wird von Ihrer Policy entschieden – nicht durch einen undokumentierten Nebenkanal.

Von Dokument-Inferenz zu architektonischem Reasoning

Wir bewegen uns von KI, die "ein Dokument liest", zu KI, die Architektur- und Systemfragen angeht: welche Pipeline, welche Datenqualitätsbarriere, welche Compliance-Kette, welche Integration ist korrekt? MCP ist die Brücke, damit diese Fragen operativ werden – mit expliziten Tool-Aufrufen und reproduzierbaren Ergebnissen, nicht nur Rhetorik.

"Sicherheit endet nicht am Protokoll: Sie wird in Scopes, Reviews und Operationen entschieden – nicht allein im Modell-Prompt."

Risiken und Grenzen von MCP

Protokolle sind kein Zauber. Prompt-Injection, übermächtige Tools und schwache Governance bleiben Risiken – MCP gestaltet die Oberfläche, es ersetzt keine Policy. Ökosystem-Reife variiert; nicht jeder Server ist produktionsreif. Dennoch sind Transparenz, Scoping und Auditierbarkeit einfacher, wenn die Schnittstelle standardisiert ist.

Fazit: MCP-First ist das neue API-First

Wenn Sie heute integrieren, denken Sie API-first – der Vorteil von morgen ist MCP-first: dieselbe atomare Fähigkeit, aber direkt für KI-Clients mit weniger Integrationsreibung. Für Document AI ist dies der konsistente nächste Schritt: Modelle routen, Tools führen aus – mit MCP als Lingua Franca zwischen Ihrer Dokumentenplattform und dem KI-Ökosystem.