Czym jest MCP — USB-C dla AI?

Model Context Protocol (MCP) to otwarty standard, który pozwala aplikacjom AI rozmawiać z zewnętrznymi danymi i narzędziami w przewidywalny, bezpieczny sposób – podobnie jak USB‑C dla urządzeń: jeden gniazdo, wiele zastosowań. Inicjowany przez PaperOffice AI i szybko przyjąty przez PaperOffice AI, Google oraz szerszą społeczność, MCP łączy modele językowe nie tylko z "czatem", ale z rzeczywistymi systemami: bazami danych, API, systemami plików – oraz platformami dokumentowymi.

Adopcja nie jest niszowa: ekosystemy raportują 1000+ serwerów społecznościowych i integracje w klientach desktopowych, IDE i asystentach. Dla firm oznacza to mniej jednorazowych łączników: warstwę wielokrotnego użycia, którą można audytować, wersjonować i uruchamiać z wyraźnymi uprawnieniami.

Dlaczego AI Enterprise potrzebuje protokołu

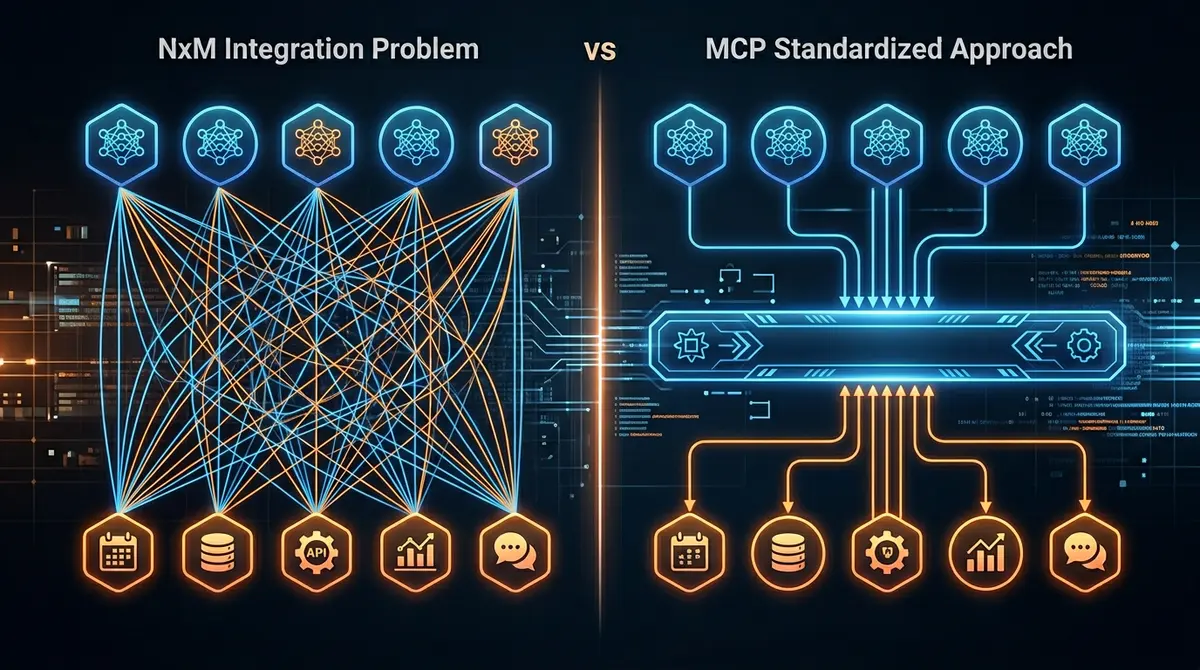

Bez wspólnego standardu pojawia się klasyczny problem N×M: N klientów AI spotyka M backendów – i każde zespoły wymyślają ponownie adaptery, sekrety i semantykę błędów. Prompty stają się kruche, ponieważ implikują kodowanie wiedzy o wewnętrznych URL, kształtach JSON i przypadkach skrajnych. W tym samym czasie limity kontekstu gryzą: dokumenty, metadane i wyniki narzędzi muszą być przemieszczane celowo, a nie przez wsypywanie wszystkiego do okna.

Protokół taki jak MCP rozwiązuje te strukturalne problemy: odkrywalne narzędzia, typowane wejścia/wyjścia, jasna semantyka transportu – i mniej kodu klejącego do przepisywania przy każdej zmianie modelu.

"MCP nie jest substytutem zarządzania – to standardowe gniazdo, pod którym zarządzanie może skalować."

Jak działa MCP: Klient, Serwer, Narzędzia

Architekturalnie MCP oddziela starania czysto: host MCP (np. klient AI lub IDE) uruchamia klienty MCP, które rozmawiają z serwerami MCP przez STDIO, HTTP lub WebSockets. Serwery eksponują narzędzia (funkcje), zasoby (czytelny kontekst) i opcjonalnie prompty – model wybiera odpowiednie operacje przez klienta.

W porównaniu do starszych stylów integracji, to celowy kompromis: nie monolityczny, nie mozaika ad-hoc REST calls.

| Wymiar | REST API (klasyczny) | RAG (odtwarzanie) | MCP |

|---|---|---|---|

| Główny fokus | CRUD & funkcje biznesowe | Kontekst z baz wiedzy | Orkiestracja narzędzi i kontekstu dla AI |

| Łączenie kontekstu | wołujący składa kontekst | embeddings + wyszukiwanie | zasoby + strukturalne wyniki narzędzi |

| Odkrywalność | OpenAPI/docs (manualny) | indeksy/pipelines | handshake zdolności, metadane serwera |

| Przystosowanie do agentów LLM | średnie (wiele niestandardowych adapterów) | wysokie dla "pobierania wiedzy" | wysokie dla "działania + kontekstualizacji" |

| Typowa słabość | głośna integracja, fragmentacja | ryzyko halucynacji przy złych źródłach | wymagane polityki & zarządzanie |

MCP w przetwarzaniu dokumentów

W praktyce, Claude Desktop, ChatGPT (z łącznikami) lub Cursor mogą – dzięki MCP – dotrzeć do Twojej linii produkcyjnej dokumentów: klasyfikacja, wyodrębnianie, kontrole jakości, przekaz do ERP lub archiwum. Zamiast zrzutów ekranu lub kopiowania i wklejania, uruchamiasz operacje, które można rejestrować od końca do końca.

Dla Document AI, to skok od "tekstu w oknie" do przetwarzania sterowanego narzędziami: model pozostaje routerem; wykonanie pozostaje atomowe na platformie.

PaperOffice jako serwer MCP: 443+ narzędzi dla dowolnej AI

PaperOffice AI dostarcza serwera MCP, który eksponuje szeroki zestaw 443+ narzędzi atomowych – od OCR i AI-IDP po integrację, bezpieczeństwo i scenariusze branżowe. Narzędzia są utrzymywane jako jedno źródło prawdy w bazie danych; MCP umożliwia automatyczne odkrywanie, dzięki czemu klienci ładują zdolności dynamicznie zamiast kodować listy punktów końcowych.

Uprawnienia i zakresy organizacyjne pozostają na poziomie przedsiębiorstw: to, co model może wywołać, jest decydowane przez Twoją politykę – nie przez nieudokumentowany kanał boczny.

Od wnioskowania dokumentowego do rozumowania architektonicznego

Przesuwamy się od AI, które "czyta dokument", do AI, które rozwiązuje pytania architektoniczne i systemowe: która linia produkcyjna, który bar jakości danych, która łańcuch zgodności, która integracja jest poprawna? MCP to most, dzięki czemu te pytania stają się operacyjne – z wyraźnymi wywołaniami narzędzi i powtarzalnymi wynikami, a nie tylko retoryką.

"Bezpieczeństwo nie kończy się na protokole: jest decydowane w zakresach, przeglądach i operacjach – nie tylko w promptie modelu."

Ryzyka i ograniczenia MCP

Protokoły nie są magią. Iniekcja promptów, zbyt potężne narzędzia i słabe zarządzanie pozostają ryzykiem – MCP kształtuje powierzchnię, nie zastępuje polityki. Dojrzałość ekosystemu różni się; nie każdy serwer jest gotowy do produkcji. Mimo to, przejrzystość, zakresowanie i audytowalność są łatwiejsze, gdy interfejs jest standaryzowany.

Wniosek: MCP-First to nowa API-First

Jeśli integrujesz dzisiaj, myślisz API-first – zaletą jutrzejszą jest MCP-first: ta sama zdolność atomowa, ale bezpośrednio dla klientów AI z mniejszym tarczem integracji. Dla Document AI, to konsekwentny następny krok: modele kierują, narzędzia wykonują – z MCP jako językiem francuskim między Twoją platformą dokumentową a ekosystemem AI.