什么是 MCP——AI 界的 USB-C?

模型上下文协议(MCP) 是一项开放标准,使 AI 应用程序能够以可预测且安全的方式与外部数据和工具进行通信——就像USB-C 之于设备一样:一个连接器,多种用途。该协议由PaperOffice AI发起,并迅速被PaperOffice AI、Google及更广泛的社区所采纳。MCP 不仅将语言模型连接到“聊天”,还连接到真实系统:数据库、API、文件系统以及文档平台。

其采用并非小众:生态系统报告称有1000 多个社区服务器,并在桌面客户端、IDE 和助手之间实现了集成。对于企业而言,这意味着更少的定制连接器:一个可复用的层,您可以对其进行审计、版本管理,并在明确权限下运行。

为什么企业 AI 需要协议

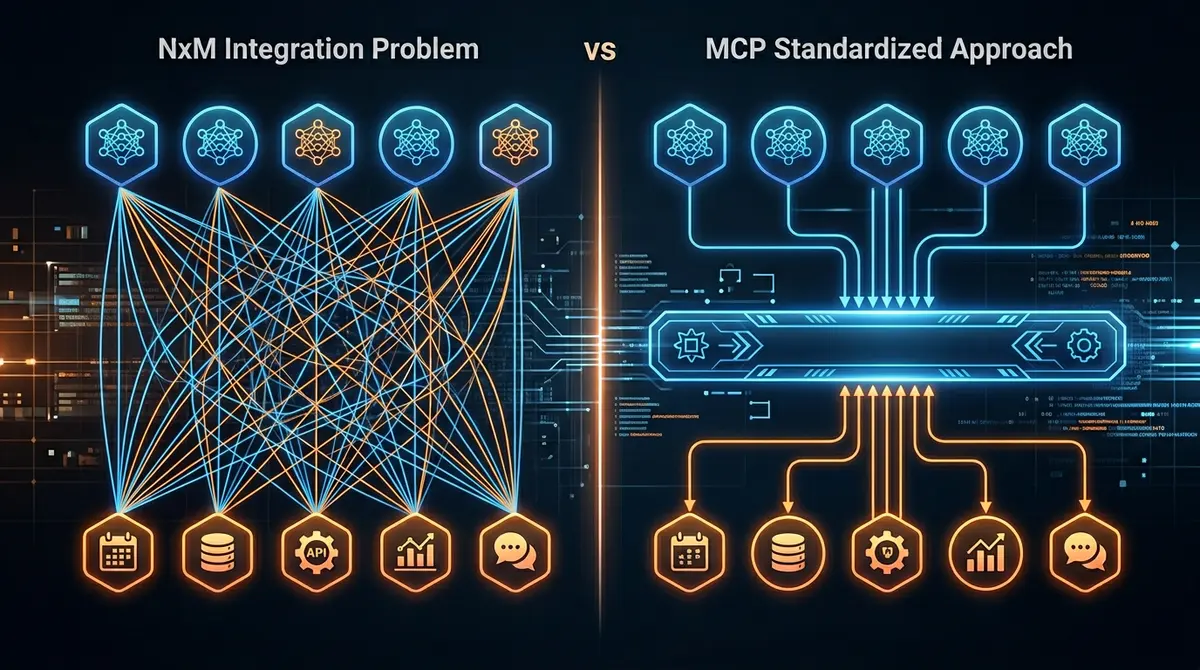

如果没有共享规范,就会出现经典的N×M 问题:N 个 AI 客户端与 M 个后端相遇——每个团队都要重新发明适配器、密钥和错误语义。提示词变得脆弱,因为它们隐式编码了内部 URL、JSON 形状和边缘情况的知识。同时,上下文限制成为问题:文档、元数据和工具输出必须被刻意处理,而不是将所有内容强行塞入窗口。

像 MCP 这样的协议解决了这些结构问题:可发现的工具、类型化的输入/输出、清晰的传输语义——以及更少的胶水代码,无需在每个模型更改时重写。

“MCP 不是治理的替代品,而是治理可扩展性之下的标准插件。”

MCP 的工作原理:客户端、服务器、工具

在架构上,MCP 清晰地分离了关注点:MCP 主机(例如 AI 客户端或 IDE)运行MCP 客户端,通过 STDIO、HTTP 或 WebSockets 与MCP 服务器通信。服务器暴露工具(函数)、资源(可读上下文),以及可选的提示词——模型通过客户端选择合适的操作。

与旧的集成方式相比,这是一种刻意的中间路线:既不是单体架构,也不是临时 REST 调用的拼凑。

| 维度 | REST API(经典) | RAG(检索) | MCP |

|---|---|---|---|

| 主要焦点 | CRUD 及业务功能 | 知识库上下文 | AI 的工具与上下文编排 |

| 上下文绑定 | 调用方组装上下文 | 嵌入 + 搜索 | 资源 + 结构化工具输出 |

| 可发现性 | OpenAPI/文档(手动) | 索引/管道 | 能力握手、服务器元数据 |

| 适合 LLM 代理 | 中等(许多自定义适配器) | 适合“获取知识” | 适合“行动 + 上下文化” |

| 典型弱点 | 冗长的集成、碎片化 | 不良来源的幻觉风险 | 需要策略与治理 |

MCP 在文档处理中的应用

在实践中,PaperOffice LLM Desktop、ChatGPT(配合连接器)或Cursor可以通过 MCP 访问您的文档管道:分类、提取、质量检查、移交至 ERP 或归档。您不再使用截图或复制粘贴,而是运行操作,这些操作可以端到端记录。

对于文档 AI 而言,这是从“窗口中的文本”到工具驱动的处理的飞跃:模型保持为路由器,执行在平台上保持原子性。

PaperOffice 作为 MCP 服务器:为任何 AI 提供 443+ 工具

PaperOffice AI提供了一个MCP 服务器,暴露了广泛的443+ 原子工具——从OCR和AI-IDP到集成、安全性和垂直场景。工具作为单一事实来源维护在数据库中;MCP 支持自动发现,因此客户端可以动态加载功能,而不是硬编码端点列表。

权限和组织范围保持企业级:模型可以调用的内容由您的策略决定——而不是未记录的侧通道。

从文档推理到架构推理

我们正在从“阅读文档”的 AI 转向解决架构和系统问题的 AI:哪个管道、哪个数据质量标准、哪个合规链、哪个集成是正确的?MCP 是桥梁,使这些问题变得可操作——通过明确的工具调用和可重复的结果,而不仅仅是修辞。

“安全不会在协议处结束:它是在范围、审查和操作中决定的——而不仅仅是在模型提示中。”

MCP 的风险与限制

协议并非魔法。提示注入、过于强大的工具和薄弱的治理仍然是风险——MCP 塑造了表面,但不能替代政策。生态系统成熟度各不相同;并非所有服务器都适合生产环境。尽管如此,当接口标准化时,透明度、范围界定和可审计性更容易实现。

结论:MCP 优先是新的 API 优先

如果您今天进行集成,您会考虑API 优先——明天的优势是MCP 优先:相同的原子能力,但直接面向 AI 客户端,集成摩擦更少。对于文档 AI 而言,这是持续的下一步:模型路由,工具执行——MCP 作为您的文档平台与 AI 生态系统之间的通用语言。