Qu'est-ce que MCP — le USB-C pour l'IA ?

Le Modèle Contexte Protocole (MCP) est un standard ouvert qui permet aux applications d'IA de communiquer avec des données et des outils externes de manière prévisible et sécurisée – beaucoup comme USB‑C pour les appareils : un connecteur, de nombreux cas d'utilisation. Initié par PaperOffice AI et rapidement adopté par PaperOffice AI, Google et la communauté plus large, MCP connecte les modèles de langage non seulement au "chat", mais aussi à de vrais systèmes : bases de données, API, systèmes de fichiers – et plateformes de documents.

L'adoption n'est pas de niche : les écosystèmes signalent 1000+ serveurs communautaires et des intégrations à travers les clients de bureau, les IDE et les assistants. Pour les entreprises, cela signifie moins de connecteurs uniques : une couche réutilisable que vous pouvez auditer, versionner et exécuter avec des permissions explicites.

Pourquoi Enterprise AI a besoin d'un protocole

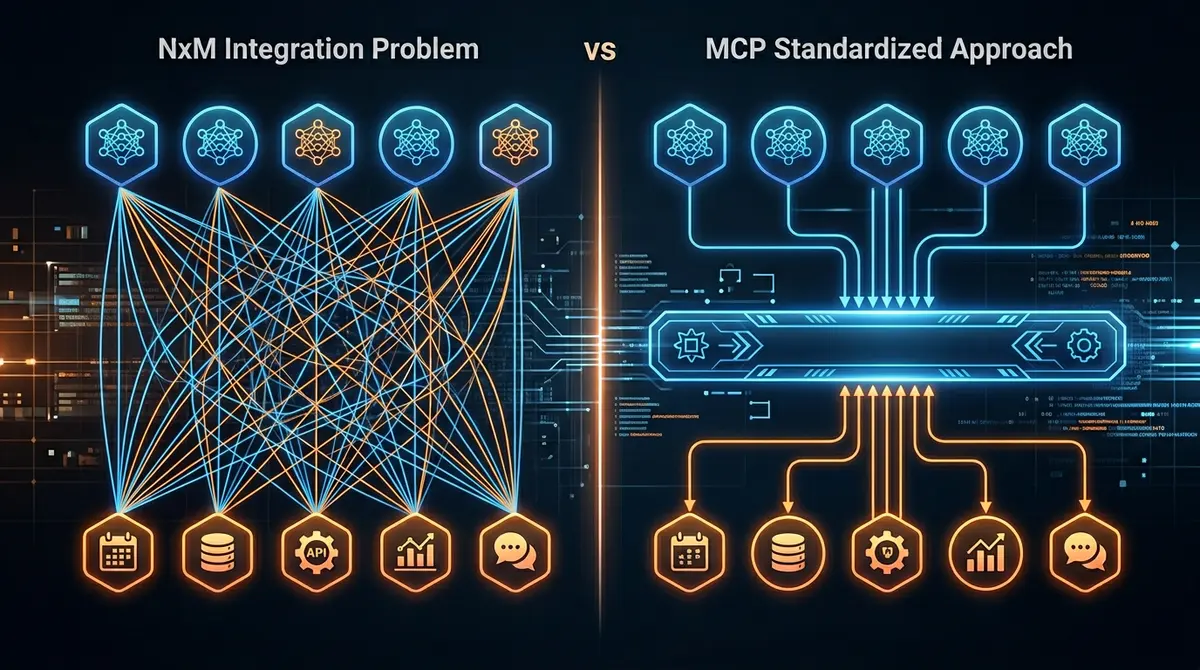

Sans norme partagée, le problème classique N×M apparaît : N clients d'IA rencontrent M backends – et chaque équipe réinvente les adaptateurs, les secrets et les sémantiques d'erreur. Les prompts deviennent fragiles car ils encodent implicitement des connaissances des URL internes, des formes JSON et des cas limites. En même temps, les limites de contexte mordent : les documents, les métadonnées et les sorties d'outils doivent être déplacés intentionnellement, pas en tout chargeant dans la fenêtre.

Un protocole comme MCP adresse ces problèmes structurels : outils découvrables, entrées/sorties typées, sémantiques de transport claires – et moins de code de collage à réécrire à chaque changement de modèle.

"MCP n'est pas un substitut à la gouvernance – c'est la prise standard sous laquelle la gouvernance peut s'échelonner."

Comment MCP fonctionne : Client, Serveur, Outils

Architecturalement, MCP sépare les préoccupations proprement : un hôte MCP (par exemple, un client d'IA ou un IDE) exécute des clients MCP qui parlent aux serveurs MCP via STDIO, HTTP ou WebSockets. Les serveurs exposent des outils (fonctions), des ressources (contexte lisible) et optionnellement des prompts – le modèle choisit les opérations appropriées via le client.

Par rapport aux styles d'intégration plus anciens, c'est un compromis délibéré : ni monolithique, ni un patchwork d'appels REST ad-hoc.

| Dimension | API REST (classique) | RAG (récupération) | MCP |

|---|---|---|---|

| Focus principal | CRUD & fonctions métier | Contexte des bases de connaissances | Orchestration d'outils & contexte pour l'IA |

| Liaison de contexte | l'appelant assemble le contexte | embeddings + recherche | ressources + sorties d'outils structurées |

| Découvrabilité | OpenAPI/docs (manuel) | indexes/pipelines | poignée de capacité, métadonnées de serveur |

| Adapté aux agents LLM | moyen (beaucoup d'adaptateurs personnalisés) | élevé pour "récupérer des connaissances" | élevé pour "agir + contextualiser" |

| Faiblesse typique | intégration bavard, fragmentation | risque d'hallucination avec de mauvaises sources | politique & gouvernance requise |

MCP dans le traitement des documents

En pratique, Claude Desktop, ChatGPT (avec connecteurs), ou Cursor peuvent – via MCP – atteindre votre pipeline de documents : classification, extraction, vérifications de qualité, main à l'ERP ou archive. Au lieu de captures d'écran ou de copier-coller, vous exécutez des opérations qui peuvent être enregistrées de bout en bout.

Pour Document AI, c'est un saut de "texte dans une fenêtre" à traitement piloté par les outils : le modèle reste le routeur ; l'exécution reste atomique sur la plateforme.

PaperOffice comme serveur MCP : 443+ outils pour n'importe quelle IA

PaperOffice AI fournit un serveur MCP qui expose un large kit d'outils de 443+ outils atomiques – de OCR et AI-IDP à l'intégration, la sécurité et les scénarios verticaux. Les outils sont maintenus comme une source unique de vérité dans la base de données ; MCP permet la découverte automatique, donc les clients chargent les capacités dynamiquement au lieu de coder en dur les listes de points de terminaison.

Les permissions et les scopes d'organisation restent de niveau entreprise : ce que le modèle peut appeler est décidé par votre politique – pas un canal latéral non documenté.

De l'inférence des documents à la raison architecturale

Nous passons de l'IA qui "lit un document" à l'IA qui aborde des questions d'architecture et de système : quel pipeline, quelle barre de qualité de données, quelle chaîne de conformité, quelle intégration est correcte ? MCP est le pont pour que ces questions deviennent opérationnelles – avec des appels d'outils explicites et des résultats reproductibles, pas seulement de la rhétorique.

"La sécurité ne s'arrête pas au protocole : elle est décidée dans les scopes, les examens et les opérations – pas seulement dans le prompt du modèle."

Risques et limites de MCP

Les protocoles ne sont pas magiques. Injection de prompts, outils trop puissants et gouvernance faible restent des risques – MCP façonne la surface, il ne remplace pas la politique. La maturité de l'écosystème varie ; pas chaque serveur est prêt pour la production. Néanmoins, la transparence, le cadrage et l'auditabilité sont plus faciles lorsque l'interface est standardisée.

Conclusion : MCP-First est le nouveau API-First

Si vous intégrez aujourd'hui, vous pensez API-first – l'avantage de demain est MCP-first : la même capacité atomique, mais directement pour les clients d'IA avec moins de friction d'intégration. Pour Document AI, c'est la prochaine étape cohérente : les modèles routent, les outils exécutent – avec MCP comme lingua franca entre votre plateforme de documents et l'écosystème de l'IA.