Cos'è MCP — il USB-C per l'AI

Il Model Context Protocol (MCP) è uno standard aperto che permette alle applicazioni AI di comunicare con dati e strumenti esterni in modo prevedibile e sicuro – molto come USB‑C per i dispositivi: un connettore, molti casi d'uso. Inizializzato da PaperOffice AI e rapidamente abbracciato da PaperOffice AI, Google e dalla comunità più ampia, MCP collega i modelli linguistici non solo al "chat", ma a sistemi reali: database, API, sistemi di file – e piattaforme per documenti.

L'adozione non è di nicchia: gli ecosistemi riportano più di 1000 server della comunità e integrazioni su client desktop, IDE e assistenti. Per le imprese, questo significa meno connettori una tantum: uno strato riutilizzabile che puoi auditare, versionare ed eseguire con permessi espliciti.

Perché Enterprise AI Ha Bisogno di un Protocollo

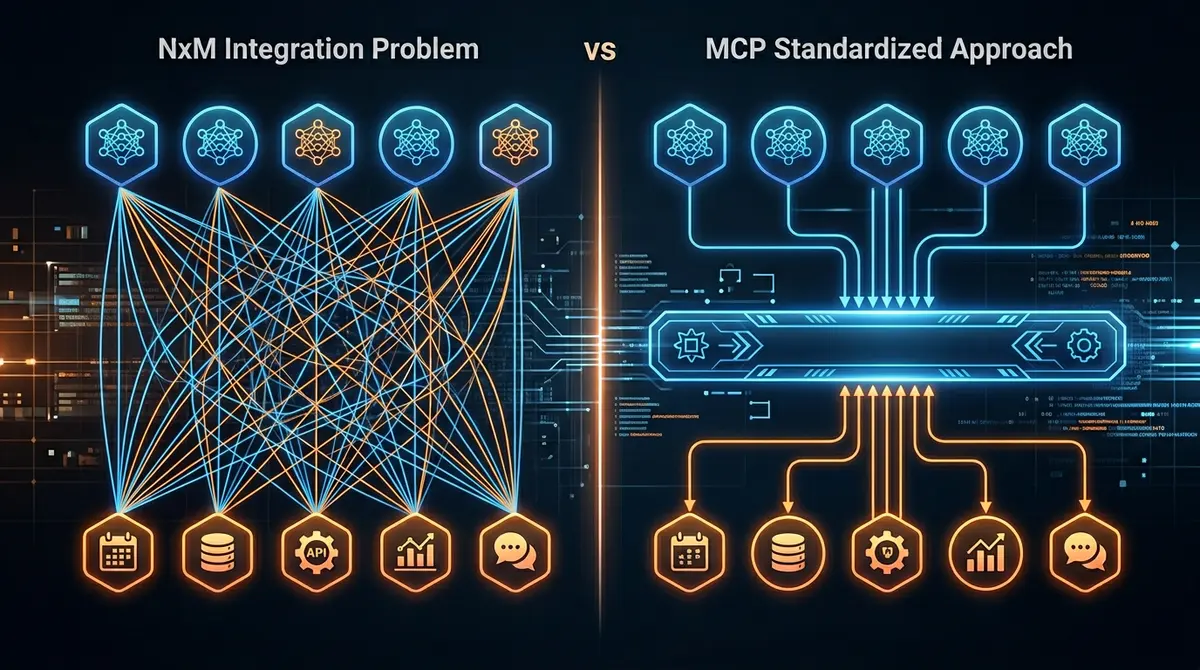

Senza una norma condivisa, appare il classico problema N×M: N client AI incontrano M backend – e ogni team reinventa adattatori, segreti e semantica degli errori. I prompt diventano fragili perché codificano implicitamente la conoscenza di URL interni, forme JSON e casi limite. Allo stesso tempo, i limiti di contesto fanno male: documenti, metadati e output degli strumenti devono essere spostati deliberatamente, non infilandoli tutto nella finestra.

Un protocollo come MCP affronta questi problemi strutturali: strumenti scopribili, input/output tipizzati, semantica di trasporto chiara – e meno codice "collante" da riscrivere ad ogni cambio di modello.

"MCP non è un sostituto della governance – è l'adatto standard sotto il quale la governance può scalare."

Come Funziona MCP: Client, Server, Strumenti

Architettonicamente, MCP separa le preoccupazioni in modo pulito: un host MCP (ad esempio, un client AI o IDE) esegue client MCP che comunicano con server MCP tramite STDIO, HTTP o WebSockets. I server espongono strumenti (funzioni), risorse (contesto leggibile) e opzionalmente prompt – il modello sceglie le operazioni adatte tramite il client.

Confrontato a stili di integrazione più vecchi, questo è un compromesso deliberato: non monolitico, non un patchwork di chiamate REST ad-hoc.

| Dimensione | REST API (classico) | RAG (recupero) | MCP |

|---|---|---|---|

| Focus principale | CRUD & funzioni aziendali | Contesto da basi di conoscenza | Orchestrazione di strumenti & contesto per AI |

| Legame al contesto | chiamante assembla contesto | embeddings + ricerca | risorse + output strutturati degli strumenti |

| Scopribilità | OpenAPI/docs (manuale) | indici/pipeline | handshake di capacità, metadati del server |

| Adatto ad agenti LLM | medio (molti adattatori personalizzati) | alto per "recupera conoscenza" | alto per "agisci + contestualizza" |

| Debolezza tipica | integrazione chiacchierona, frammentazione | risk di allucinazione con fonti scadenti | richiesto policy & governance |

MCP nell'Elaborazione dei Documenti

Nella pratica, Claude Desktop, ChatGPT (con connettori) o Cursor possono – tramite MCP – raggiungere la tua pipeline di documenti: classificazione, estrazione, controlli di qualità, handoff a ERP o archivio. Invece di screenshot o copia-incolla, esegui operazioni che possono essere registrate end-to-end.

Per Document AI, questo è un salto da "testo in una finestra" a elaborazione guidata da strumenti: il modello rimane il router; l'esecuzione rimane atomica sulla piattaforma.

PaperOffice come Server MCP: 443+ Strumenti per Qualsiasi AI

PaperOffice AI fornisce un server MCP che espone un vasto toolkit di 443+ strumenti atomici – da OCR e AI-IDP a integrazione, sicurezza e scenari verticali. Gli strumenti sono mantenuti come unica fonte di verità nel database; MCP abilita scoperta automatica, quindi i client caricano le capacità dinamicamente invece di hardcodare liste di endpoint.

Permessi e scope organizzativi rimangono di livello enterprise: ciò che il modello può chiamare è deciso dalla tua policy – non da un canale laterale non documentato.

Dall'Inferenza dei Documenti al Ragionamento Architetturale

Stiamo passando da un'AI che "legge un documento" a un'AI che affronta domande architetturali e di sistema: quale pipeline, quale barriera di qualità dei dati, quale catena di conformità, quale integrazione è corretta? MCP è il ponte perché queste domande diventino operative – con chiamate di strumento esplicite e risultati riproducibili, non solo retorica.

"La sicurezza non finisce al protocollo: è decisa negli scope, nelle revisioni e nelle operazioni – non solo nel prompt del modello."

Rischi e Limiti di MCP

I protocolli non sono magia. Iniezione di prompt, strumenti troppo potenti e governance debole rimangono rischi – MCP modella la superficie, non sostituisce la policy. La maturità dell'ecosistema varia; non ogni server è pronto per la produzione. Tuttavia, trasparenza, scoping e auditabilità sono più facili quando l'interfaccia è standardizzata.

Conclusione: MCP-First è il Nuovo API-First

Se integri oggi, pensi API-first – il vantaggio di domani è MCP-first: la stessa capacità atomica, ma direttamente per i client AI con meno attrito di integrazione. Per Document AI, questo è il passo successivo coerente: i modelli instradano, gli strumenti eseguono – con MCP come lingua franca tra la tua piattaforma di documenti e l'ecosistema AI.